近日,国际顶级的人工智能学术会议ACM MM 2023的多模态情感识别挑战赛(Multimodal Emotion Recognition Challenge)中,深圳技术大学彭小江副教授领导的团队SZTU-MIPS在半监督多模态情绪识别赛道获得亚军,团队成员为深技大多模态智能感知系统实验室成员,包括本科生和硕士生。

半监督多模态情绪识别赛道排名

目前,深技大团队在比赛中使用的神经网络模型论文《Semi-Supervised Multimodal Emotion Recognition with Expression MAE》已被人工智能学术会议ACM MM 2023接收,并受邀在会议上作技术报告。

技术简介

多模态情绪识别旨在让计算机通过对对话、语音、视觉等内容进行特征分析,感知人类当前情绪状态,该技术的宗旨是使得机器人具有情感智能。本次竞赛的多模态情感识别任务,包含多标签学习(MER-MULTI)、模态鲁棒性(MER-NOISE)和半监督学习(MER-SEMI)三个赛道。本次大赛共有76支队伍报名参赛,汇集了世界一流的科技公司和学术机构。

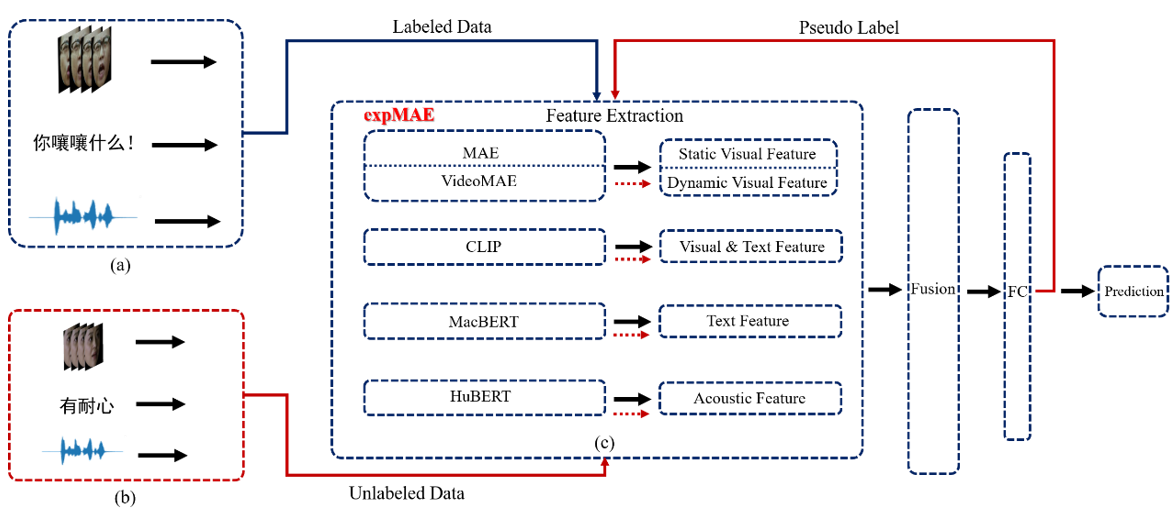

深技大MIPS团队将视频划分为语音、台词及图像三个模态,结合图像静态特征、视频动态特征、语音特征、台词情感特征、跨台词图像模态特征等进行联合训练,利用分解的双性池化策略(Factorized Bilinear Pooling)模块实现模态融合,达到了出色的分类表现。

团队中大四本科生林钰翔同学通过观察得出训练集样本不平衡,易使模型学习出现偏差,从而难以分辨特定类别等问题。他提出利用无标签数据生成伪标签数据策略,扩充数据集样本,调整训练数据比例,这一策略受到评委的肯定。

供稿|大数据与互联网学院 程泽浜 林钰翔

编辑|党委宣传部